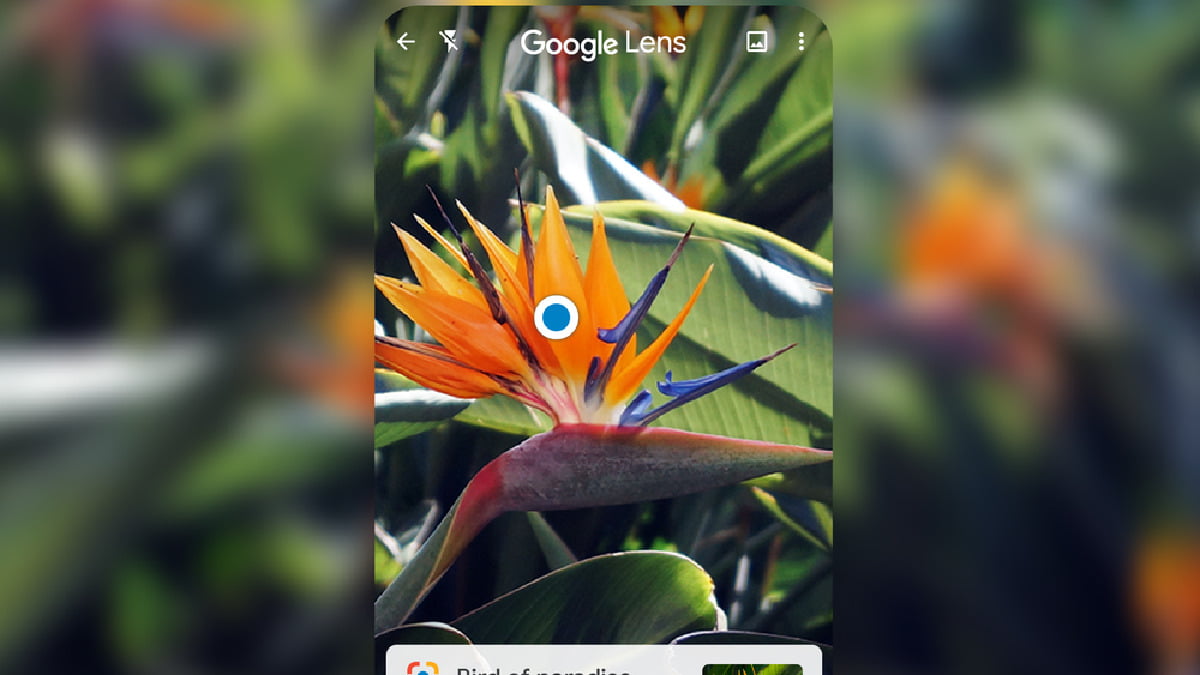

Görüntüleri ve metni aynı anda arayabilen bir Google Lens özelliği olan Multisearch, bu yılın başlarında beta olarak ABD’ye geldikten sonra yakında daha geniş bir şekilde kullanıma sunulacak.

Google Lens için dil desteği genişletiliyor. Google, çoklu aramanın önümüzdeki aylarda 70’ten fazla dile genişleyeceğini söylüyor. Şirket duyuruyu Arama odaklı bir etkinlikte yaptı. Buna ek olarak, Google’ın Mayıs ayında I/O’da tanıttığı Near Me özelliği, bu sonbaharda İngilizce olarak ABD’ye gelecek. Bu, insanların yerel işletmeler hakkında daha fazla ayrıntı bulmasını kolaylaştırma fikriyle çoklu aramaya bağlanıyor.

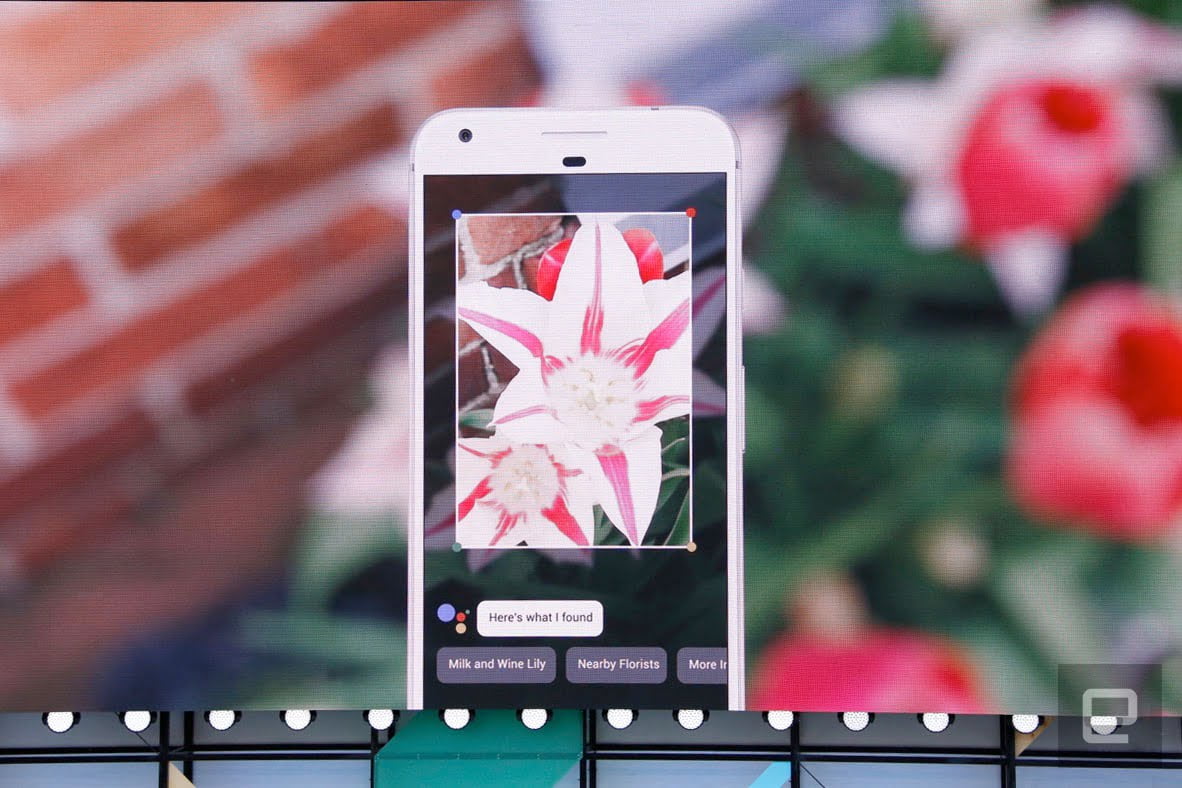

Çoklu arama, büyük ölçüde insanların kameralarını bir şeye yöneltmelerini ve Google uygulamasını kullanırken bu konuda soru sormalarını sağlamakla ilgili. Örneğin, telefonunuzu bir mağazaya doğrultabilir ve mağazayla ilgili ayrıntıları talep edebilir veya bir giyim eşyası gibi tanıdık olmayan herhangi bir öğenin ekran görüntüsünü sorabilirsiniz. Ayrıca çorba veya köfte gibi belirli bir yiyeceği araştırabilir ve çevrenizdeki hangi restoranların bunu sunduğunu görebilirsiniz.

Google Lens için dil desteği genişletiliyor

Ayrıca Lens cephesinde, artırılmış gerçeklik çevirileri söz konusu olduğunda bazı değişiklikler olacak. Google, çeviriyi üste bindirmek yerine orijinal metnin yerini alıyormuş gibi görünmesini sağlamak için Pixel 6’nın Sihirli Silgi özelliği için kullandığı yapay zeka teknolojisinin aynısını kullanıyor. Buradaki fikir, çevirilerin daha sorunsuz ve doğal görünmesini sağlamak.

Google ayrıca iOS uygulamasında arama çubuğunun altına kısayollar ekliyor, böylece kameranızla metin çevirme, ekran görüntülerinde metin aramak ve çevirmek için mırıldanma gibi özellikleri daha kolay bulacaksınız.

Inter, Terra Luna’nın yaratıcısı için kırmızı bülten çıkardı