OpenAI, kullanıcıların sağlıkla ilgili sorularını daha güvenli ve organize bir şekilde yanıtlamak amacıyla ChatGPT Health özelliğini tanıttı. Şirket verilerine göre her hafta 230 milyon kişi yapay zekaya sağlık konusunda danışıyor. Yeni özellik hassas verileri diğer sohbetlerden ayırarak gizliliği ön planda tutmayı hedefliyor. İşte detaylar…

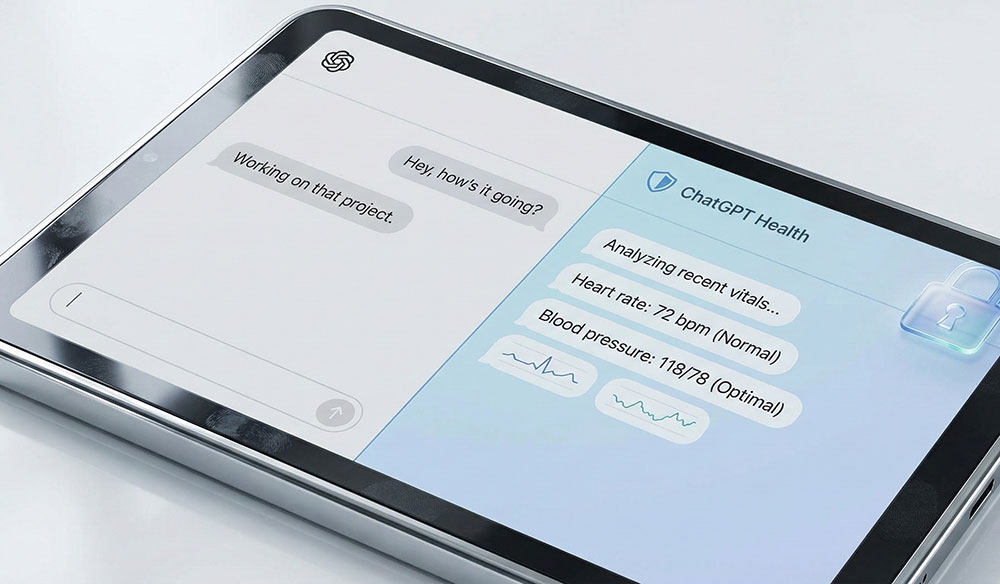

ChatGPT Health, kullanıcıların sağlık durumları, hastalık belirtileri veya yaşam kalitesi hedefleri hakkında yapay zeka ile konuşabilecekleri tamamen ayrıştırılmış özel bir alan sunuyor. Yeni sistem, sağlıkla ilgili sohbetleri, günlük konuşmalardan izole ediyor. Bu sayede konuşmaların bağlamı, yapay zeka ile yapılan diğer genel sohbetlere karışmıyor.

Sistemin çalışma prensibi kullanıcıyı doğru alana yönlendirmek üzerine kurulu. Eğer kullanıcı standart sohbet ekranında sağlıkla ilgili bir konu açarsa, yapay zeka onu otomatik olarak sağlık bölümüne geçmesi konusunda uyarıyor ve daha önceki diyaloglarda edindiği bağlamdan yararlanıyor. Örneğin kullanıcı normal sohbet kısmında koşu antrenmanı istediyse, sağlık bölümünde fitness hedeflerinden bahsettiğinde de yapay zeka koşu bilgisini bilerek yanıt veriyor.

ChatGPT Health, sadece sohbetle sınırlı kalmayıp dış kaynaklardan veri de alabiliyor. Tüketiciler Apple Health, Function ve MyFitnessPal gibi popüler sağlık ve egzersiz uygulamalarındaki verilerini sisteme entegre edebilecek. OpenAI, gizlilik endişelerini gidermek adına önemli bir taahhütte bulundu. Şirket, sağlık bölümünde yapılan konuşmaların ve paylaşılan verilerin yapay zeka modellerinin eğitminde asla yer almayacağının altını çizdi.

OpenAI yöneticilerinden Fidji Simo, bu girişimi sağlık sistemindeki doktor yetersizliği, randevu bulma zorluğu ve yüksek maliyetler gibi küresel sorunlara bir yanıt olarak nitelendiriyor. Ancak teknoloji dünyası ve tıp otoriteleri temkinli. ChatGPT gibi araçlar yani Büyük Dil Modelleri bir bilginin doğruluğunu kontrol etmekten ziyade, kelimeleri istatistiksel olarak tahmin ederek cümle kuruyor. Bu durum yapay zekanın ‘halüsinasyon’ görmesine, diğer deyişle tamamen yanlış veya uydurma bir bilgiyi gerçekmiş gibi söylemesine neden olabiliyor. OpenAI da bu riskin farkında olarak, hizmetin kullanım koşullarında sistemin tıbbi teşhis veya tedavi amacıyla kullanılmaması gerektiğini açıkça belirtiyor. Özelliğin önümüzdeki haftalarda kullanıma sunulması bekleniyor.