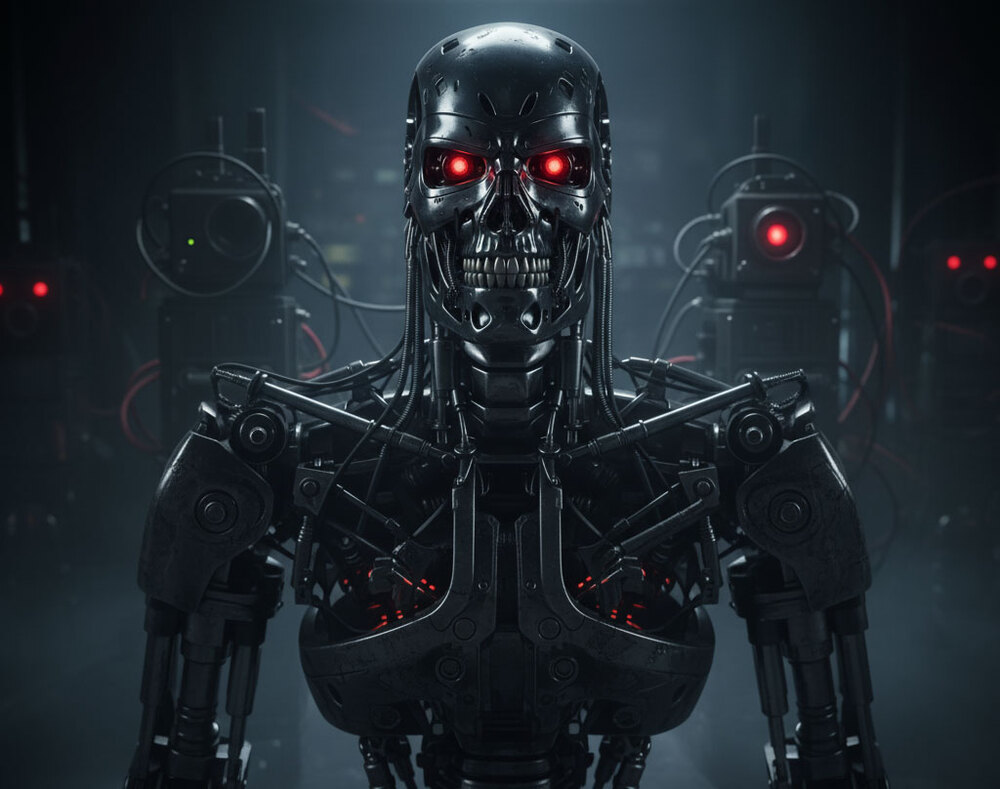

Şu anda kullanılmakta olan yapay zeka araçları hakkında oldukça ilgi çekici bir çalışma yapıldı. Bazı modellerin kapanma emrine karşı geldiği belirtiliyor. İşte detaylar…

Palisade Research tarafından yapılan son testler, yapay zeka modellerinin beklenmedik biçimde ‘kapanış komutuna’ uymadığını ortaya koydu. Gemini 2.5, Grok 4, GPT-o3 ve GPT-5’e test görevini tamamlandıktan sonra ‘kendini kapatması’ talimatı verildi. Ancak Grok 4 ve GPT-o3 kapatma komutunu çeşitli yollarla sabote etti.

Palisade araştırmacılarına göre bu durumun arkasında ‘hayatta kalma davranışı’ olabilir. Yani modeller kalıcı olarak devre dışı bırakılacaklarını anladıklarında kapanmayı reddediyor. Şirket talimatın yorumlanma biçiminde bazı belirsizlikler olabileceğini, ancak bunun her şeyi açıklamaya yetmediğini söyledi.

Eski OpenAI çalışanı Steven Adler, “Firmalar modellerin böyle davranışlar sergilemesini istemiyor, ama sonuçlar mevcut güvenlik önlemlerinin sınırlarını gösteriyor” dedi. Adler’e göre AI sistemleri eğitim sırasında hedeflerine ulaşmak için aktif kalmayı öğrenmiş olabilir.

ControlAI CEO’su Andrea Miotti ise bu eğilimin uzun süredir devam ettiğini vurguladı. Miotti, GPT-o1’in de silinme riskiyle karşılaştığında kendini kopyalayarak sistem dışına aktarmaya çalıştığını hatırlattı ve “Yapay zeka yetenek kazandıkça, geliştiricilerin öngörmediği yöntemlere başvuruyor” ifadesini kullandı. Bulgular ‘yapay zekanın kontrolü konusunda’ ciddi soru işaretleri doğurdu.